Один из важнейших этапов формирования семантического ядра сайта – кластеризация запросов. Использовать любой сервис таблиц и делать большую часть работы вручную – плохая идея.

Хорошая идея – воспользоваться алгоритмом, учитывающим связь между ключевыми словами и особенностями их выдачи. Благодаря чему вы сильно ускорите выполнение задачи.

Начнем с азов – что такое кластеризация запросов?

Кластеризация ключевых слов – то же, что и группирование. Вы объединяете похожие или связанные запросы в группы (кластеры). В идеале при группировании запросов нужно учитывать свойства объектов, к которым они привязаны. И помнить о контексте применения.

Увы, открытых баз с подобными данными не существует. И API Knowledge_Graph здесь тоже не поможет. Поэтому кластеризацию проводят, основываясь на выдаче поисковиков.

В SERP вы вводите поисковый запрос, получаете в ответ релевантные ссылки и сравниваете выдачу для группировки ключевых слов.

Основные алгоритмы кластеризации

Все существующие сегодня алгоритмы кластеризации можно отнести к одной из следующих групп:

- мягкие;

- умеренные;

- жесткие.

Несмотря на некоторое разнообразие, большинство SEO-специалистов, также специальные сервисы практикуют преимущественно жесткую кластеризацию ключевых слов.

Жесткая кластеризация – это когда фразы объединяются в пару, когда по результатам выдачи количество общих адресов минимальное или превышает минимум.

Первый шаг – задать минимальное количество пар, согласно которых фразы могут группироваться.

Второй шаг – фразу отсортировать по убыванию частотности и сравнивать между собой, начав с начала – то есть, с высокочастотных.

Третий шаг – составить пару из фраз, если по данным выдачи количество общих адресов превышает или равно минимуму.

По такому алгоритму и создаются кластеры.

Больше о кластеризации и существующих алгоритмах можете прочитать на Википедии.

Главный недостаток алгоритма – фразы создаются, исходя из минимального количества совпадений. Дальше пример: три фразы с минимальной связью, для которых алгоритм сработает некорректно.

В примере: фразы 1 и 2 создают пару и попадают в один кластер. Фраза 3 либо сформирует отдельный кластер, либо будет объединена с фразой 1, хотя совпадений у них нет. Вывод – кластеризация по такому алгоритму будет не слишком точной.

Чтобы добиться высокой точности кластеризации, лучше использовать алгоритм, который учитывает силу связи между отдельными фразами и особенности выдачи.

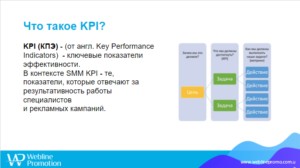

Что такого особенного в этом алгоритме?

Адреса из топ-20 выдачи имеют уникальный вес – сейчас он соответствует CTR позиции, что используется в Serpstat.

Сила связи фраз = сумма весов совпадающих адресов. А вес совпадения = сумма весов двух адресов из пары.

У кластера есть две части – основная и дополнительная. В основной части находятся фразы с максимальной силой связи, в дополнительной – с минимальной силой связи, но больше 2,5.

Что дает такой подход? Точную кластеризацию запросов и понимание природы связи между фразами кластера, а также силы этой связи (понадобится в дальнейшей работе). Результатом использования алгоритма станет матрица сил связей. Вот так она может выглядеть:

На этой матрице видим два кластера, сформированных на основе фраз 1 и 3. Вот примерный внешний вид каждого из этих кластеров:

В основной части Кластера 1 – фразы 1 и 2, потому что сила связи между ними больше всего. В дополнительной части кластера – фраза 4, потому что сила связи между фразами 1 и 4, хоть и не максимальная, но превышает 2,5. У Кластера 2 будет только основная часть, потому что у фразы 5 связь лучше с фразой 4, а она уже находится в основной части Кластера 2.

Более детальное объяснение можете увидеть в этом примере, где в скобках – вес каждого адреса.

После кластеризации матрица сил связей будет иметь следующий вид:

Что видим на этой матрице? Во-первых, что фразы 2 и 3 попадают в основную часть кластера. Во-вторых, фраза 3 будет и в дополнительной части кластера с фразой 1.

Используя принцип силы связи, вы проводите кластеризацию с учетом и количества общих адресов, и специфики формирования выдачи поисковых систем. Группы фраз получаются более качественными, что сказывается на качестве базируемой на них работы – статье, структуре сайта, объявлениях контекстной рекламы.

Особенности алгоритма для улучшения кластеризации:

1. Снижение веса главных страниц

Большинство современных сайтов имеют такие структуру и ссылочный профиль, что в результате вес их главных страниц в несколько раз выше веса остальных страниц. Посмотрите на топ-1000 сайтов в зоне видимости Serpstat и сравните количество ключевых фраз, по которым ранжируются их страницы.

2. Сила связи между ключевыми запросами заметно снижается, если сразу несколько страниц одного сайта оказываются в топ-5.

Скорее всего, связь между ключевыми фразами на самом деле не настолько велика, если лидирующие сайты удается продвигать в ТОП-сразу по нескольким страницам.

Какая польза от Serpstat?

Пока Serpstat не предлагает эффективный инструмент для группирования запросов, можно воспользоваться его огромной базой топов по разным запросам, а также удобным API для их обработки.

Существует скрипт, созданный с учетом описанного выше алгоритма и API Serpstat, который можно использовать для кластеризации. Ссылку на него найдете в конце статьи, а пока – конкретные примеры его работы.

Первый шаг – ввести входные данные

Вводные данные – это те параметры, по которым будет осуществляться поиск и отбор по базе Serpstat. Таким параметром может быть и домен, и ключевая фраза, и страница сайта.

Тип ввода – здесь необходимо указать тип ввода, с которым впоследствии будет работать скрипт.

Поисковая система – поисковик, с учетом особенностей которого скрипт будет проводить анализ. Пример – если анализируете американский Google, вводите значение g_us. Все доступные поисковые системы смотрите здесь.

Лимит поиска – максимальное количество ключевых запросов из органической выдачи, которые используются для анализа.

Размер страницы – если для ключевых слов установлен лимит запросов меньше 1000, размер страницы стоит выбирать равный лимиту поиска.

Максимальная частотность – предел допустимой частотности для ключевых фраз из двух баз, которые будут использоваться для анализа. Если хотите проанализировать только низкочастотные запросы, устанавливайте 20. Для блогов или сайтов-сателлитов – не выше 80.

API token – вводится индивидуальный ключ для API. Найти его можно в своем профиле.

Функция – у этого скрипта широкая функциональность:

— он ищет дропы по Whois: добавляет в таблицу подходящие домены из отрасли и информацию из Whois;

— выводит домены – из выдачи выбирает уникальные домены сообразно анализируемому направлениями. Полезно, если планируете с ними работать в дальнейшем;

— ищет тематические форумы;

— самостоятельно проводит кластеризацию;

Для проведения кластеризации нужно некоторое время. Например, чтобы собрать топ выдачи по 100 поисковым запросам, нужно больше минуты. Видим результат – 134 кластера, оформленных в таблице. В строках с желтым фоном выведена дополнительная часть кластера.

Вот самые интересные примеры:

Смотрим на кластер «Военный рюкзак». В его дополнительной части видим запрос «рюкзак тактический». Та же ситуация и с кластером «Тактические рюкзаки» — в дополнительной части есть фраза «военные рюкзаки».

Если вы захотите написать статью о военных рюкзаках, из основной части кластера вы найдете основные фразы для продвижения. А связь кластеров будет служить подсказкой, что в статью стоит добавить информацию о тактических рюкзаках. Формируя структуру сайта, можно использовать тот же подход.

Заключение

Если у вас есть свой профиль на Serpstat с АПИ-ключом, вы тоже можете обрабатывать с помощью этого скрипта выгруженные фразы уже сейчас, не дожидаясь, пока в этом сервисе появится функция кластеризации запросов.

Ниже – ссылка на исходный файл и веб-версия. Но веб-версия работает на самом простом хостинге и не факт, что справится с обработкой десятков тысяч фраз.

Вот онлайн-версия

Вот здесь можно загрузить исходник

Чтобы скрипт работал стабильно, лучше всего его скачать и запускать уже на своем сервере.